- ASUS routerek

- DIGI kábel TV

- Nem szavazza meg Musk 56 milliárd dolláros csomagját a norvég állami vagyonalap

- Tarr Kft. kábeltv, internet, telefon

- Milyen routert?

- Aliexpress tapasztalatok

- Donald Trump lehet a kriptobajnok elnök az USA-ban

- Telekom otthoni szolgáltatások (TV, internet, telefon)

- Videó stream letöltése

- Windows 11

-

IT café

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

Alogonomus

őstag

válasz

Petykemano

#59648

üzenetére

Petykemano

#59648

üzenetére

Egy lényegesen olcsóbb 7600X3D csak a 7800X3D eladásait csökkentené jelentős mértékben, amivel pénzt veszítene az AMD. Egy minimálisan olcsóbb 7600X3D pedig keveseket érdekelne, mert akkor már kifizetnék a teljes gép költségének a szintjén maximum 5%-ot jelentő felárat a lényegében egy 7700X "felturbózott" változatának tekinthető 7800X3D-ért.

Új AM4 processzorra pedig azért nem számíthatunk szerintem, mert az AM5 elterjedését így is nagyon akadályozza az 5800X3D megléte. Anno lényeges volt annak a processzornak a kiadása, hogy az Intel utolsó "bástyáját" is ledöntsék vele, de jelenleg már inkább az AM5 felé szeretné terelni a vásárlókat az AMD, mert az alaplapgyártók már AM5 lapokat szeretnének eladni.

Egy lényegesen olcsóbb 5600X3D bemutatásával csak új lendületet/reményt kapna az AM4-es tábor, és kevésbé lenne hajlandó AM5-re váltani. Főleg úgy, hogy az új kártyák is maradtak PCI-E 4-esek. -

M.T.

senior tag

válasz

Petykemano

#59648

üzenetére

Petykemano

#59648

üzenetére

Szerintem Totál felesleges 6 magot 3D cache -el ellátni már játékokban és az elkövetkezőkben is elkél a 8/16 ha több nem is. Persze lenne rá vevő de nem lenne annyival olcsóbb.

-

Petykemano

veterán

AYANEO to feature Ryzen 7000 CPU and discrete GPU

Ez vajon a Navi33 lenne? Elfér az egy kézikonzolban?Találgatunk, aztán majd úgyis kiderül..

-

bitblueduck

senior tag

válasz

AuraSync

#59642

üzenetére

AuraSync

#59642

üzenetére

ezt miért ide írod? szerintem küldj egy cv-t ezzel a szöveggel a frostbyte csapatnak felvesznek lead engine architect pozira.

azt csak megemlíteném, hogy steam hw survey top100-ban nincs geforce 40 vagy rx 7000 series gpu, egyik modell sem ugorja meg a 0.15%-ot.

értem én hogy vettél egy 4080-at de attól még nem akörül forog a világ.An open mind is like a fortress with its gates unbarred and unguarded.

-

hokuszpk

nagyúr

válasz

Petykemano

#59644

üzenetére

Petykemano

#59644

üzenetére

"Egy 4090 mellé ugyanis nem fogsz belépőszintű processzort venni, "

dehogynem. csak épp nem játékra ; es gyorsan kopogjuk is le, nehogy visszajöjjön a kryptoőrület.

Első AMD-m - a 65-ös - a seregben volt...

-

az Ampere mellett is ez volt.

Ki az aki egy 5600X/ FHD/ RTX 4090@ 800 ezer -1millió kombót hajt? itt nincs mellette 7900XTX...kíváncsi lennék azzal mit mutat egy 5600X.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

hokuszpk

nagyúr

válasz

Petykemano

#59657

üzenetére

Petykemano

#59657

üzenetére

bánygépbe celeronokat meg pentiumot pakoltak 4-5 db RX570...RTX2080...RTX3080 mellé.

Első AMD-m - a 65-ös - a seregben volt...

-

HSM

félisten

Tényleg nem értem, mi nem érthető azon, hogy a CPU-t próbálta tesztelni, kiiktatva a GPU limitáló hatását?

De volt ott azért gyengébb VGA is, szemléltetve a reálisabb összeállítást.

De egyébként nekem WQHD alatt is már kevésnek érződött bizonyos címek multijában az R5 3600-asom (kb a tesztbe az 5500 szintje) egy RX6800XT mellett, az 5600-al viszont már kellemes a tempó mindenhol. -

Petykemano

veterán

válasz

hokuszpk

#59659

üzenetére

hokuszpk

#59659

üzenetére

Ezt értem, de ennek szerintem nincs relevanciája abban a vitában, hogy milyen gyakori lehet az az szituáció, mennyire életszerűek azok a CPU-GPU kombinációk, amelyben a szóbanforgó feature (alacsonyabb driver overhead) hasznosan tudja kifejteni hatását.

Egyébként mondanám, hogy például életszerű szitáció lehetne az, amikor van egy már korosodó processzorod (Piledriver, Ivy vagy Haswell pl) és GPU-t szeretnél újítani. Lehet, hogy ebben a helyzetben ebből a szempontból a kisebb driver overheaddel rendelkező AMD kártya választása előnyösebb.

Csakhogy...

[link]

Találgatunk, aztán majd úgyis kiderül..

-

PuMbA

titán

válasz

Petykemano

#59662

üzenetére

Petykemano

#59662

üzenetére

A 3060-nak szerintem van két ütőkártyája. Egy a DLSS. Például a most kijött FSR 2.2 frissítés az F1 22-ben a DLSS-hez képest minőségben egy nagy nulla lett. Kettő, én például Cyberpunkot tolom RT-vel és a 3060 így pár fps-sel az RX6800 mögött van teljesítményben, szinte egál. Én ezek miatt vettem 3060-at használtan 120k-ért

Ha ezek nem számítanak, akkor a 6700XT szerintem a legjobb vétel, használtan.

Ha ezek nem számítanak, akkor a 6700XT szerintem a legjobb vétel, használtan.[ Szerkesztve ]

-

HSM

félisten

Én nemrég próbáltam a next-gen Witcher 3-ban mindkettőt minőségi beállításon, ugyanaz a minőségvesztős homályos kép.

A DLSS kicsit kevésbé, mint az FSR2.1, de inkább maradtam natív, de alacsonyabb felbontáson ugyanahhoz az FPS-hez TAUU-val, tűéles, részletes, gyönyörű képpel.

A DLSS kicsit kevésbé, mint az FSR2.1, de inkább maradtam natív, de alacsonyabb felbontáson ugyanahhoz az FPS-hez TAUU-val, tűéles, részletes, gyönyörű képpel.Ami meg a tempót illeti, max RT-vel az RX 6800XT-n volt natív FHD-n 30-35FPS, a 3060-al natívan 20, minőségi DLSS-el épphogy 30, de úgy meg a képminőség ment a sutba. Számomra egyáltalán nem lett volna ez így alternatíva. Persze, a 6800XT nyilván drágább, de van is mögötte teljesítmény. Az RT-hez szükség is van rá.

[ Szerkesztve ]

-

Nekem egyertelmu.amire reagaltam az a GPU cpu igenyere irt.Kivancsi lettem volna a 7900xtx nel mi a helyzet mert ott a tesztek alatt nem lattam jelentos elterest alacsonyabb felbontasban az Ada es RDNA3 kozott ,de lehet tevedek.Magyarul ott is megmaradt e ez vagy az RDNA3 mar elter a 2-tő.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

HSM

félisten

"Magyarul ott is megmaradt e ez vagy az RDNA3 mar elter a 2-tő."

Ha már találgatós... Nem hinném, hogy eltérne. A blokk alapján maradt a parancskiosztás alapvető felépítése, így a driver sem hinném, hogy jelentősen eltérne, legfeljebb a shader fordítás bonyolódott picit meg a dual-issue miatt.

RDNA2: [link] , RDNA3: [link] . -

Abu85

HÁZIGAZDA

Az RDNA 3-nál még kisebb az AMD D3D12 driver többletterhelése, mert bizonyos feladatoktól mentesíti a CPU-t a MDIA hardver. Az RDNA 2-nél még nem mentesül ezektől a CPU, mert nincs MDIA a lapkákban.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

PuMbA

titán

Ha az AMD nem tolja el az árazást, akkor decimálhatja az alsó és közép kategóriás lagymatag NVIDIA kártyákat. A felső kategória most sem lesz az AMD tere, ott az NVIDIA tud jobbat és a CPU limit se számít annyira, mert akinek van 1 milliója VGA-ra, annak van pénze a legerősebb procira is.

[ Szerkesztve ]

-

+ HSM

Nálatok mégis egy 5800X társaságában az RTX 4080 gyorsabb FHD és QHD felbontásban több játékban míg UHD-n már kikap.

példa:

Nekem ebből az jön le hogy a 7900XTX CPU limites kisebb felbontáson, míg a 4080 kevésbé.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

Az 5800X az egy gyors processzornak számít, így csak ott ütközik a GeForce limitbe, ahol nagyon erőteljes az execute indirect használata. Gyengébb procival nyilván nem kellene erőteljes processzorterhelés a játék oldaláról. Ezt egyébként a beállításainkkal eleve igyekszünk kiütni, mert VGA-tesztről van szó, de nem minden játékban sikerül.

Majd csinálunk ilyen CPU-GPU párválasztó tesztet, ahol nem törekszünk erre.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Alogonomus

őstag

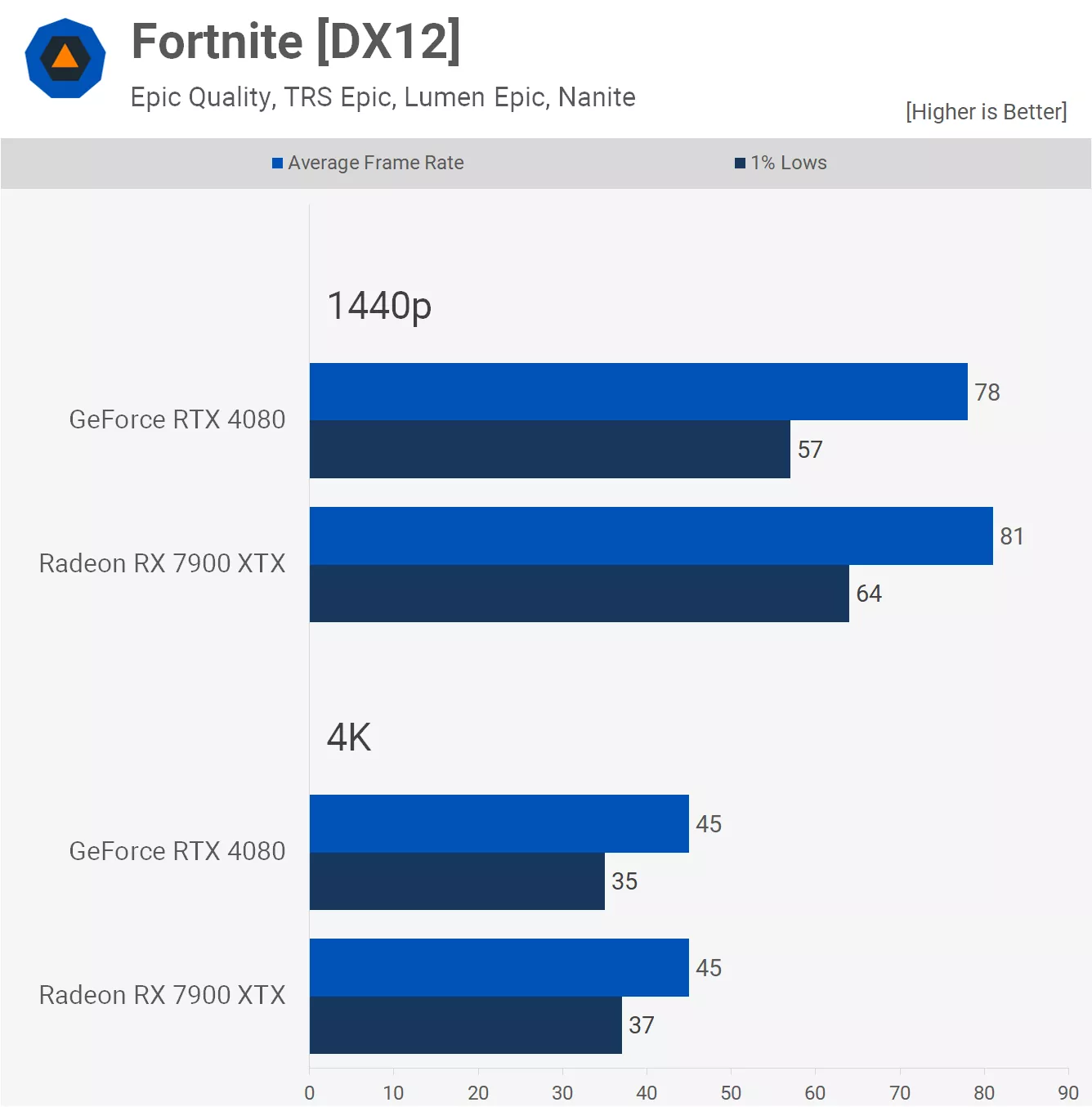

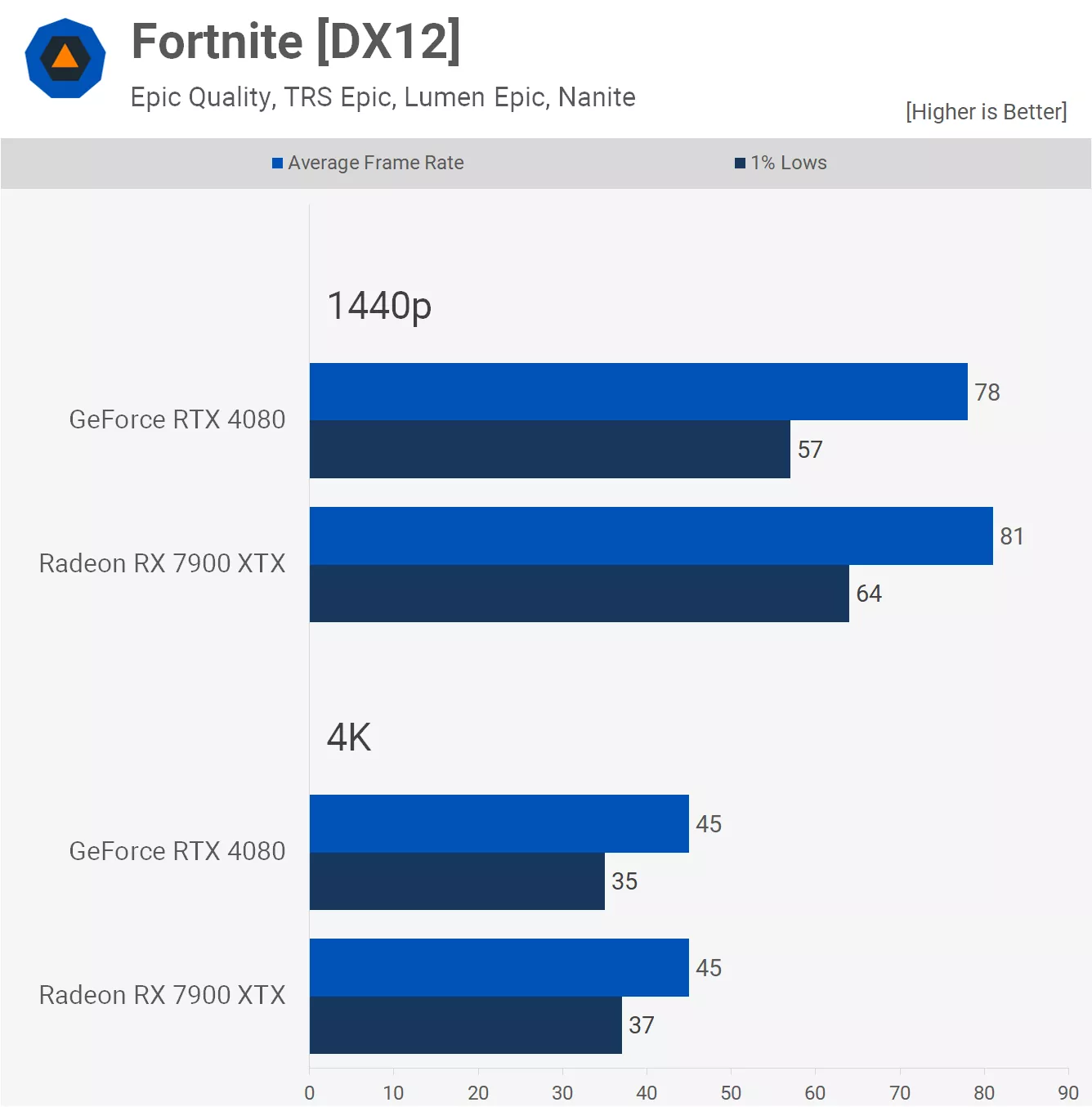

Az állást nagyban befolyásolja majd, hogy hány játék esetén jelentkezik az a komoly előny, amit a két legutolsó Call of Duty játékban láthattunk, illetve az UE 5.1 játékok aránya, mivel abban az RT látszólag az RDNA 3-nak kedvez, legalábbis a 4080 vs. 7900 XTX tesztben mindkét felbontás esetén az XTX jött ki jobban az RT bekapcsolásából.

-

PuMbA

titán

válasz

Alogonomus

#59671

üzenetére

Alogonomus

#59671

üzenetére

Ebben a generációban az ár a mindent eldöntő tényező. Az NVIDIA azért ad ilyen gyér specifikációs 4070 Ti-t és azért lesz ilyen gyér a 4060 specifikációja, mert ennyi fér bele az árba ezen a gyártástechnológián. Ez nem feltétlenül baj, mert az előző generáció használtan ott van, az kegyetlen olcsó marad az idők végezetéig, csak így nehéz helyzetben van a 4000-res széria, mert házon belül a 3000-res konkurenciává válik. Kíváncsi vagyok, hogy az NVIDIA hogy akarja ezt kisakkozni.

[ Szerkesztve ]

-

4080 ról van szó és CPU limitről. CB tesztben UHD fölött és alatt is tesztelik őket és QHD ban is.

[link]

tehát továbbra is kíváncsi lennék arra alacsony felbontáson a 7900XTX hogyan viselkedik a 4090 és 4080 mellett .

CPU limites helyzetben meg van e ugyan az a forgatókönyv ami volt az előző genben, mert nekem nem úgy tűnik, [link] de nem találok teszteket FHD-n régebbi CPU val, mert újabbakkal alacsony felbontáson a 4080 előnye nagyobb.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

Megvan ugyanez a különbség az Ada és az RDNA 3 között is. Annyi, hogy az RDNA 3-nak az MDIA miatt, az RDNA 2-höz viszonyítva még kisebb lett a többletterhelése az execute indirecttel dolgozó D3D12 címekben.

A problémát egyébként leírtam elég részletesen ebben a hsz-ben: [link]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Yany

addikt

Hát nem csak a felső, de a középkategóriában sem képes piacot szerezni: [link] Nem kicsit jobban megy a 4070Ti, mint a Radeonok.

Ez nagyon gyengus. Érdemes lenne valakinek ott a csapatban elfilózni, hogy mivel a teljesítménnyel nincs gond, vajon mivel van. Én már többször is elsoroltam.Építs kötélhidat - https://u3d.as/3078

-

Lehet hogy megvan csak nem látom tesztekben sehol. Pont az ellenkezőjét látom ,hogy alacsonyabb felbontáson nagyobb az Ada előnye az RDNA3 hoz nézve.

Nem találok rá tesztet ezért lett volna jó a HU beleteszi a 7900XTX -et is abba tesztbe.

Pl ez elég érdekes eredmény, visszautalva a kiinduláshoz.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

A HU már csinált egy tesztet 4090-nel és 6950XT-vel. [link] - látható, hogy az overhead probléma az erre érzékeny D3D12-es játékokban megmaradt. De ez normális. Ahhoz, hogy ez megváltozzon, az NV-nek pure bindless hardvert kell építeni. Utána ki tudják dobni a driverből a bekötéshez számukra alapvetően szükséges emulátort, ami végeredményben a nagyobb többletterhelést okozza.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Én arra utalok hogy ez érinti a 7900XTX et( RDNA3 at) is a tesztek szerint ugyan úgy, mint az Ada-t, lásd feljebb Fortnite

A 4090 egy vadállat az azért limites, nincs még CPU ami azt kimaxolja szerintem, majd a 3D 7000 Ryzen.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

Leírtam már párszor, hogy az RDNA 3-nak a többletterhelése az RDNA 2-nél is kisebb. Emiatt még gyengébb procival is beéri. Ennek az oka, hogy minden olyan előnnyel rendelkezik, amivel az RDNA 2 rendelkezett, és mellé még az MDIA fel tudja venni az execute indirectet alkalmazó játékok parancskötegeit, amikről ad egy információt a drivernek, hogy ha látja a parancsköteget a parancslistában, akkor ne is költsön rá a CPU erőforrást, hanem csak szóljon az MDIA-nak, hogy a GPU-ban letárolt adatot töltse be újra. Ezzel minden ilyen művelet nulla CPU-időt vesz igénybe az RDNA 3-nál. A többi hardver azért bukik ezen, mert nem tudja hol tárolni az előre felvett parancsokat, egyszerűen minden frame során újra meg kell csinálni ugyanazt, míg az RDNA 3 addig csak töltöget, amíg a parancsok ismétlődnek. Tehát az első feldolgozás után minden további ismétlés teljesen ingyenes a CPU oldalán.

Ezt az MDIA-t valószínűleg sokan le fogják másolni a jövőben, mert nem nehéz megvalósítani hardveresen, és elképesztően sokat ér CPU-limites környezetben.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Leírtad én meg elírtam hogy ezt nem látom sehol hogy így lenne még nálatok teszten sem. Mit nem értesz meg ezen?

Ott a Fortnite teszt a 7900XTX CPU limites mint az állat a 6950XT vel van egy szinten, mint a 4080 ugyan úgy, 1080 P-n .

Én elhiszem neked, csak mutass már nekem egy 1080P-1440P tesztet ahol a 4080 CPU limites a 7900XTX meg nem.

Pont ez volt a kiindulási kommentemben is...[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

[link] - mert nem olvastad el ezt. Ebben benne van, hogy az NV hardverét is lehet jól működővé tenni, ha az adott motor megszegi a Microsoft ajánlásait, és olyan helyre rakja az erőforrásokat, ahova nagyon nem ajánlott. Ennek megvan a maga baja, de alapvetően megcsinálható. Vannak azonban olyan stúdiók, akik nem tesznek így, például Ubisoft, Infinity Ward, Treyarch, IO interactive, ésatöbbi-ésatöbbi. Ennek ezernyi oka lehet, például akár olyan banális is, hogy egy erőforrásra olyan formátumot használnak, amit nem eszik meg a root signature, tehát akármennyire is követni akarnák az NV ajánlásait, muszáj a Microsoft által javasolt helyére rakni az erőforrást.

Ezért van az, hogy a HU is csak bizonyos D3D12 játékban mér erőteljes limitet, és nem mindenhol. Jellemzően az Ubisoft játékokban, mert azok erőforrás-kezelése teljesen szabványos, ugyanis elég sok olyan formátumot használnak, ami nem tölthető be a root signature-be. Nem tudnak mit tenni ezzel, nem úgy építették fel a motorjaikat, hogy figyelembe vették volna az NV hardverek kényességét, utólag átírni pedig már extrém körülményes lenne, mert minden optimalizálást az aktuális működésre húztak fel. Egyszerűen meg kell várniuk, amíg az NV hoz egy pure bindless hardvert, és akkor az is úgy fog működni, ahogy a Radeonok.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Hidd el nem kételkedek abban amit írsz csak lássak erre mérést ( ezért kár hogy a HU kihagyta ezt) majd ahol ez látszik, mert jelenleg a régi játékokkal, se gyengébb ( 5800X 5600X ) sincs olyan tesztben ( már kb 1,5 órája nézek videókat és olvasom őket) nem látszik az ami az RDNA2- Ampere helyzet volt 1080p-n . Vagy az RDNA3 nál történt negatív változás vagy az Ada-ban pozitív változás.

A Fortnite egyértelműen CPU limites RDNA3 nál is ugyan olyan mértékben.

Most szerintem engedjük el , mert én tényhívő vagyok, majd ha lesz ilyen teszt visszatérünk rá A HU nem ezt tesztelte ,amit én kérdésként feszegetek.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

HSM

félisten

Ebben az is benne lehet, hogy a 4070Ti mindenhol nagy számban kapható, ezerféle modell. Ehhez képest 7900XT és XTX alig és kevés fajta van készleten, főleg az AIB modellek ritkásan.

Én egyébként gondolkozás nélkül egy jó AIB 7900XT-t vinnék 4070Ti-k helyett. Van egy 3060-am, engem nem győzött meg különösebben sem a DLSS, sem a driver. Ugyanúgy teszi a dolgát a 6800XT is. Persze, valamivel több a bug, de ezt nálam ellensúlyozza, hogy nincs regisztrációhoz kötve egy halom hasznos funkció, és ezerszer kényelmesebb a felület. -

Abu85

HÁZIGAZDA

Az Ada ebben az Ampere-hez képest nem változott. Az RDNA 2-höz képest az RDNA 3 annyit változott, hogy kevesebb prociidővel is beéri az execute indirectes játékokban.

Ha pedig látni akarod ezt a limitet az Ada és az RDNA 3 esetében, akkor nézzél AC Valhallát, vagy Cod MW2-t. Azok CPU-limitesek, és a Microsoft ajánlásai szerint vannak írva, vagyis az NV-nek nagyon sok többletterhelése lesz a driver emulációs rétegéken intenzív működése miatt.A CPU-limit önmagában nem számít, ha a Microsoft ajánlásaival ellentétben van írva a program. Akkor a GeForce is tud jól működni. Le is írtam a linkelt hsz-ben, hogy miért. Akkor van nagyon erős többletterhelés a GeForce-on, hogy a Microsoft ajánlásai szerint vannak elhelyezve az erőforrások. Ez régen is így volt. A korábbi HU tesztben sem volt mindig driverből mindent verő a Radeon. Bizonyos játékokban volt az. Nyugodtan nézd vissza.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Néztem ezeket a játékokat,de szinte ugyan annyival gyorsabb FHD-n az RDNA3 mint 4 K-n nincs eltérés amikor CPU limit és amikor VGA limit van a két kártya között, sőt, FHD-n kisebb. ( 4080-7900XTX)

És például ezeken a képeken tökéletesen látszik hogy az Ampere megfekszik FHD-n, a 3090 Ti kikap a 6900XT től, majd 4 K-ban már odaveri vagy 15 % kal. Az Ada- RDNA3 között nincs ilyen.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

-

Ha az 5800X megfelelően erős lenne akkor az Ampere sem lenne CPU limites a fenti tesztben ,de a az 5800X mellett a 3090Ti CPU limites a 4080 meg 20% kal erősebb: tessék: [link]

Amúgy nincs olyan teszt amiben gyenge CPU mnellett benne van a 7900XTx és a 4080 is.

A HU kizárólag a 4090 et nézte ezért tettem be neked a Forntite FHD tesztet aminél a 7900XTX is CPU limites, a 6950 nel van pariban. Az az érzésem ha a HU tesztben benne lenne a 7900XTX és a 4080 is egy szinten lennének azokkal a CPU -kal. Szerintem amúgy nem rontok el semmit, az Ampere mellett kijött a különbség az 5800X -nél, te is láthatod az Ada-nál meg nem, összenézve a 7900XTX el.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Hellwhatever

aktív tag

Arra lennék kíváncsi hogy ez mennyire valós piaci szegmens: 3600 + 7900 XT(X)

Execute indirect meg CPU limit ide vagy oda megint nincs válasz a konkurencia zászlóshajójára, amire az RDNA 1 óta nem volt példa (5700 XT vs. 2080 Ti). Az az előrelépés amit az RDNA 2-vel összeszedtek (bemákoltak?) mára nagyjából el is olvadt és ezen egy rommá húzott 7900 XTX se segítene: OC comparison: Radeon RX 7900 XTX vs. Geforce RTX 4080 OC - ComputerBase

Nagyjából itt borul az az elmélet hogy az RTX 4090 fogyasztására adott reakciók miatt skálázta vissza az AMD a 7900 XTX-et...

-

Abu85

HÁZIGAZDA

Nem is klasszikus CPU-limites. Inkább vegyes limit van. A klasszikus CPU-limit az, amikor sorakoznak a VGA-k. Ha nem sorakoznak, de nem skálázódnak annyira, az vegyeslimit.

Én meg isten tudja, hogy hányszor írtam le, hogy az NV hardvereknek nem az a baja, hogy ne tudnának működni, ha a program a root signature-be ment erőforrást, hanem az a bajuk, hogy ha nem így van megírva a program, akkor register flushra kényszerülnek, és ez elveszi a sebességet, amellett, hogy CPU többletterhelést is okoz. De ez játékfüggő. Ha az erőforrás berakható a root signature-be, akkor a flush elkerülhető, és elég csak az ellenőrzést futtatni a CPU-nak a driver által, hogy van-e elég regiszter a bekötéshez. A Fortnite például ilyen program. Tehát meg lehet írni úgy is a játékot, hogy skálázódjon a GeForce hardvereken, csak nem mindig kifizetődő, és az már a motor felépítésétől függ, hogy az-e. Ezért van az, hogy a régi HU-s overhead tesztekben az egyes D3D12 játékokban abszolút nem látszanak a GeForce-ok limitesnek, míg más D3D12 játékokban játékokban elég szar sebességet adnak gyengébb procival. Ez teljesen a játék válogatja, és főleg aszerint, hogy a fejlesztők mennyire tartották be az NVIDIA ajánlásait.

Egyébként attól is függ még, hogy saját memóriamenedzsmentet írtak-e a játékhoz, vagy egyszerűen letöltötték az AMD D3D12MA-ját, és jóvanazúgy, megspóroltak egy év optimalizálást. Ez azért kritikus kérdés, mert a D3D12MA csak a Microsoft ajánlásai szerinti bekötéssel tud működni, a root signature-be kötött erőforrásokat nem támogatja. Ezért nem túl jók a legutóbbi COD játékok GeForce-on, mert az Activision stúdiói leállították a saját memóriamenedzsment fejlesztését, és mindenhova az AMD D3D12MA-t használják. És ezzel jönnek azok a kötöttségek, hogy hiába mondja az NV, hogy nem olyan jó a GeForce-onak, ha nem a root signature-ben van az erőforrás, nem tudják hova helyezni, mert a D3D12MA máshol nem kezeli.

A 7900 XTX az talán pár százalékkal nagyobb sebességet kínálna a HU új tesztjében, mint a 6950XT, mert ott az MDIA. De a tesztelt játékok annyira nem használják ennek előnyeit, tehát maximum 2-3%-ról lenne szó. Kb. úgy nézne ki a teszt, hogy a WD Legion alatt a 4090 tud 90 fps-t a 13100 CPU-val, a 6650XT 98 fps-t, a 6950 XT 99 fps-t, és a 7900XTX tudna 100-101-et.

#59689 Hellwhatever : Kisebb GPU-t viszont használsz hozzá, és ott ugyanúgy létezik ez a jelenség. Alapvetően számolni kell azzal, hogy ha 150 dollár alatti CPU-t használsz, akkor D3D12-re jobb a hasonló árú Radeon, mert kisebb az overheadje a drivernek. De ez nem újdonság. Régóta így van.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

S_x96x_S

őstag

válasz

Yutani

#59691

üzenetére

Yutani

#59691

üzenetére

>> Abu85: NV hardverek ... A Fortnite például ilyen program.

> Viszont ahogy bekapcsolod az RT-t, okafogyottá válik a fejtegetésed.Fortnite ( RT Lumen and Nanite enabled ) esetén azért az 7900 XTX elég versenyképes,

és az RTX 4080 nem nagyon tud akkora előnyt mutatni.persze lehet más magyarázat is mint az ABU-é .. de akkor fejtsd ki jobban.

"What's interesting here is that ray tracing performance in Fortnite, which is one of the best examples of RT effects in any game right now, sees the 7900 XTX and RTX 4080 neck and neck. In fact, the Radeon GPU actually does a better job here with RT Lumen and Nanite enabled, and that's a surprising result."

https://www.techspot.com/review/2599-radeon-7900-xtx-vs-geforce-rtx-4080/

[ Szerkesztve ]

Mottó: "A verseny jó!"

-

T.Peter

őstag

RX 7900 XTX vs Unreal Engine 5.1 with Lumen, Nanite, Ray Tracing, and TSR! (Tested in Fortnite) - YouTube

Unreal Engine 5.1 | RTX 4090 | Fortnite Updated with Lumen, Nanite, and more! - YouTube

Ezek alapjan mondjuk mindegy, mert nem sok kulonbseg van frame rate-ben hw rt off/on kozott. -

S_x96x_S

őstag

válasz

T.Peter

#59695

üzenetére

T.Peter

#59695

üzenetére

> mert nem sok kulonbseg van frame rate-ben hw rt off/on kozott.

"RT Lumen and Nanite" nincs engedélyezve akkor a 4080 4K-ban egy picit jobb.

Ha meg engedélyezve van, akkor már fej-fej mellett van a 2 GPU.

és ez már jelentős eltérés:4K 7900 XTX Fortnite DX12

- "TRS epic, Lumen Epic, Nanite" ON : 45 fps

- "TRS epic, Lumen Epic, Nanite" OFF : 82 fps <----Mottó: "A verseny jó!"

-

Alogonomus

őstag

válasz

S_x96x_S

#59692

üzenetére

S_x96x_S

#59692

üzenetére

És ehhez még hozzátartozik, hogy UE 5.1 esetén nem egy kikapcsolt RT melletti - mondjuk 10% - AMD előnyből lesz bekapcsolt RT esetén kiegyenlített a helyzet, hanem a 1440p esetén 1%-os XTX előny növekszik 4%-ra RT esetén, míg a 4K mellett még 96-82 állással 15% hátrányban levő XTX RT esetén már kiegyenlít, sőt 1% low tekintetében a 9% hátrányt 6% előnybe fordítja.

Persze egy mérés nem mérés, másik UE 5.1-es játékban esetleg más eredmény születik majd, valamint AMD processzorral mérve a SAM is valószínűleg jelentett 1-2% előnyt a piros kártyának, viszont az XTX drivere még a most elérhetőnél is kiforratlanabb állapotú volt.

Mindenesetre az első valós játékban mért UE 5.1-es RT eredmények határozottan a piros oldalnak előnyösebbek. -

S_x96x_S

őstag

válasz

T.Peter

#59697

üzenetére

T.Peter

#59697

üzenetére

> En az sw/hw kozti elteresrol irtam.

sajnos nagyon nehéz leválasztani a sw és a hw -t az FPS-es eredményről ..

főleg ha a sw-hez hozzátartozik az ABU által említett:

- vajon "a fejlesztők mennyire tartották be az NVIDIA ajánlásait." .. témakör is.

( meg az AMD/Microsoft .. ajánlásait is )a legtöbb (vég) felhasználót ( ~ játékost ) meg

úgyis csak az ár/fps mutató érdekli, ami nagyon változatos ..A játékfejlesztőknek meg kompromisszumot kell kötni a konzolos AMD és a desktop-os nVidia dominancia között - ami nem mindig sikerül és itt az Intel is az ARC -al.

meg van még pár mobil GPU is.Tisztán csak a HW elméleti képessége is érdekes lehet ..

de a Cell procinál (PS3) nem mindig lehetett olyan könnyen gyakorlati teljesítményre átváltani. - vagyis kell a kettőt együtt nézni.Ha félreértettelek volna - akkor elnézést ..

Mottó: "A verseny jó!"

-

PuMbA

titán

válasz

S_x96x_S

#59699

üzenetére

S_x96x_S

#59699

üzenetére

"A játékfejlesztőknek meg kompromisszumot kell kötni a konzolos AMD és a desktop-os nVidia dominancia között"

Ez fontos

Mindegy mi az ajánlás, egy játékfejlesztő se akarja a VGA tulajok 90%-át elszomorítani lassúsággal, mert az ő játékeladási számaik bánják.

Mindegy mi az ajánlás, egy játékfejlesztő se akarja a VGA tulajok 90%-át elszomorítani lassúsággal, mert az ő játékeladási számaik bánják.[ Szerkesztve ]

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

Állásajánlatok

Cég: Ozeki Kft.

Város: Debrecen

A DLSS kicsit kevésbé, mint az FSR2.1, de inkább maradtam natív, de alacsonyabb felbontáson ugyanahhoz az FPS-hez TAUU-val, tűéles, részletes, gyönyörű képpel.

A DLSS kicsit kevésbé, mint az FSR2.1, de inkább maradtam natív, de alacsonyabb felbontáson ugyanahhoz az FPS-hez TAUU-val, tűéles, részletes, gyönyörű képpel.